Imaginate que alguien descarga una imagen o un vídeo tuyo de Internet, lo pasa por una herramienta de inteligencia artificial para crear un video falso con tu voz y movimientos exactos, y lo utiliza para acceder a tu cuenta bancaria, completar la autenticación biométrica y robarte todo tu dinero. Esto es ya una realidad para los delincuentes que realizan estafas. De acuerdo a un análisis de Appdome, una empresa especializada en la defensa de aplicaciones móviles, América Latina se ha convertido en un peligroso punto caliente para el fraude que implica la tecnología deepfake, es decir, la manipulación de imágenes con fines ilícitos.

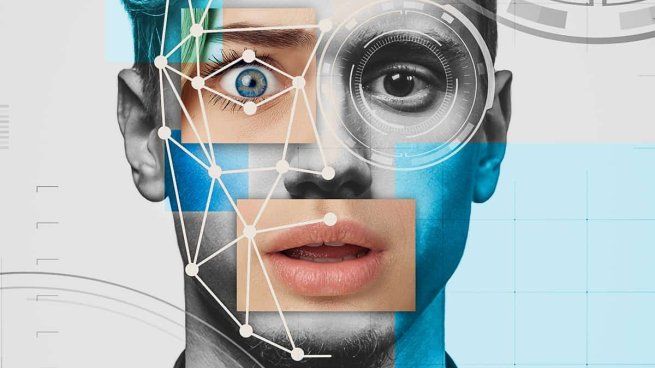

Deepfake: historias de Inteligencia Artificial hiperrealistas que ahora pueden robar cuentas bancarias

Un problema que podía utilizarse para manipular campañas políticas y publicitarias con vídeos y rostros trucados ha adquirido ahora un protagonismo aún mayor. Sin embargo, nuevas funciones de seguridad pueden proteger a usuarios y empresas

-

Este es el mejor pueblo de Japón para irse de vacaciones en 2025, según la Inteligencia Artificial

-

OpenAI anunció GPT4-5, su modelo de lenguaje de Inteligencia Artificial más grande

Los países de la región están cada vez más en la mira de los delincuentes, que están a punto de intensificar los robos con tecnología deepfake.

Los países de la región están cada vez más en la mira de los delincuentes, que están a punto de intensificar los robos con tecnología deepfake. En Brasil ya se han registrado casos alarmantes, en los que particulares y empresas han perdido grandes sumas de dinero. A finales del año pasado, un grupo utilizó este fraude impulsado por IA para infiltrarse en cuentas y desviar 110 millones de BRL. «En China, un caso similar se desarrolló de manera diferente: los delincuentes utilizaron tecnología deepfake para simular una videollamada y convencieron a un ejecutivo para que realizara transferencias por un total de más de 20 millones de dólares. Estos incidentes se están extendiendo, facilitando las cosas a los delincuentes en los países latinoamericanos, donde la demanda de herramientas de IA ha aumentado», afirma Tom Tovar, CEO y cofundador de Appdome.

Los contenidos generados por IA, conocidos como deepfakes, pueden crear versiones increíblemente realistas de rostros, voces y movimientos humanos en vídeos, archivos de audio e imágenes. «Inicialmente, los deepfakes se convirtieron en una preocupación pública debido a su papel en la falsificación de campañas publicitarias, por ejemplo. Ahora, nos enfrentamos a un problema mucho mayor: el robo de millones de dólares a particulares y empresas. En poco tiempo, seremos testigos de un impacto económico masivo. Por eso nos hemos comprometido a proporcionar una herramienta que pueda bloquear estas estafas, incluso en países donde aún no se han denunciado, para poder prevenirlas antes de que empiecen», explica Tovar.

«Como parte de su compromiso con la ciberseguridad, las empresas tecnológicas deben proteger a los usuarios de este tipo de estafas», afirma Tovar, quien explica que existen nuevas defensas combaten varios tipos de fraude. Detectan los intentos de eludir Face ID -cuando los delincuentes utilizan imágenes o vídeos manipulados para engañar a los sistemas de reconocimiento facial- e identifican las aplicaciones deepfake o de intercambio de caras que intentan eludir los mecanismos de verificación. Las soluciones bloquean las imágenes de cámaras virtuales o vídeos pregrabados utilizados durante los procesos de autenticación y reconocen los intentos de clonación de voz, protegiendo los sistemas que utilizan la tecnología «mi voz es mi contraseña».

Una característica destacada es el sistema avanzado de detección de la vitalidad, que va más allá de las indicaciones tradicionales como parpadear o girar la cabeza. La herramienta analiza la textura de la piel, los reflejos de los ojos, las condiciones de iluminación y la profundidad facial para asegurarse de que la persona que está delante de la cámara es real. A medida que las deepfakes se extienden y las técnicas delictivas se sofistican, las empresas se enfrentan al reto de proteger los datos sensibles sin comprometer la experiencia del usuario. «No podemos evitar que se creen deepfakes, pero sí podemos bloquear su uso dentro de las aplicaciones móviles», subraya Tovar.

En ese sentido, las soluciones que se plantean los especialistas no sólo bloquean el fraude en tiempo real, sino que también proporcionan informes detallados sobre los ataques detectados. Las empresas pueden utilizar esta información para mejorar las estrategias de seguridad y personalizar las respuestas a los usuarios cuando se identifican intentos de fraude. Además de proteger a bancos y empresas de tecnología financiera contra la apropiación de cuentas y el fraude financiero, las nuevas herramientas también mejoran la seguridad en aplicaciones de compras, redes sociales, servicios de mensajería y plataformas de autenticación basadas en el reconocimiento facial o de voz, convirtiéndose en un aliado clave para garantizar una experiencia segura a millones de usuarios en todo el mundo.

Dejá tu comentario